MetaHuman Animator llega listo para grabar animaciones. Epic ha anunciado Metahuman Animator, una nueva característica de MetaHuman que permitirá a los usuarios usar un iPhone o una cámara montada en un casco estéreo para reproducir cualquier actuación facial como animación de alta fidelidad en personajes de MetaHuman.

MetaHuman Animator te permitirá utilizar tu iPhone o una cámara montada en un casco estéreo (HMC) para reproducir cualquier actuación facial como una animación de alta fidelidad en personajes de MetaHuman. Con él, podrás capturar la individualidad, realismo y fidelidad de la actuación de tu actor y transferir cada detalle y matiz a cualquier personaje de MetaHuman para darles vida en Unreal Engine.

Los humanos digitales fotorrealistas necesitan una animación de alta calidad para ofrecer actuaciones realmente creíbles, pero la experiencia y el tiempo para crearla son un desafío incluso para los creadores más habilidosos. Es increíblemente difícil para las soluciones existentes de captura de rendimiento recrear fielmente cada matiz de la actuación del actor en tu personaje. Para lograr una animación verdaderamente realista, a menudo se requiere que los animadores experimentados ajusten cuidadosamente los resultados en un proceso generalmente arduo y que consume mucho tiempo.

¡Pero eso está a punto de cambiar!

Planeado para ser lanzado en los próximos meses, MetaHuman Animator producirá la calidad de animación facial requerida por los desarrolladores de juegos AAA y los cineastas de Hollywood, al mismo tiempo que será accesible para estudios independientes e incluso aficionados. Con el iPhone que ya puedes tener en tu bolsillo y un trípode estándar, puedes crear una animación creíble para tus personajes de MetaHuman que construirá conexiones emocionales con tu audiencia, incluso si no te consideras un animador.

MetaHuman Animator también funciona con cualquier solución profesional de captura estereoscópica vertical HMC, incluyendo las de Technoprops, lo que ofrece resultados aún más de alta calidad. Y si también tienes un sistema de mocap para la captura del cuerpo, el soporte de MetaHuman Animator para el código de tiempo significa que la animación de rendimiento facial se puede alinear fácilmente con la captura de movimiento del cuerpo y el audio para ofrecer una actuación completa del personaje. Incluso puede utilizar el audio para producir una convincente animación de la lengua.

¿Cómo funciona Metahuman Animator?

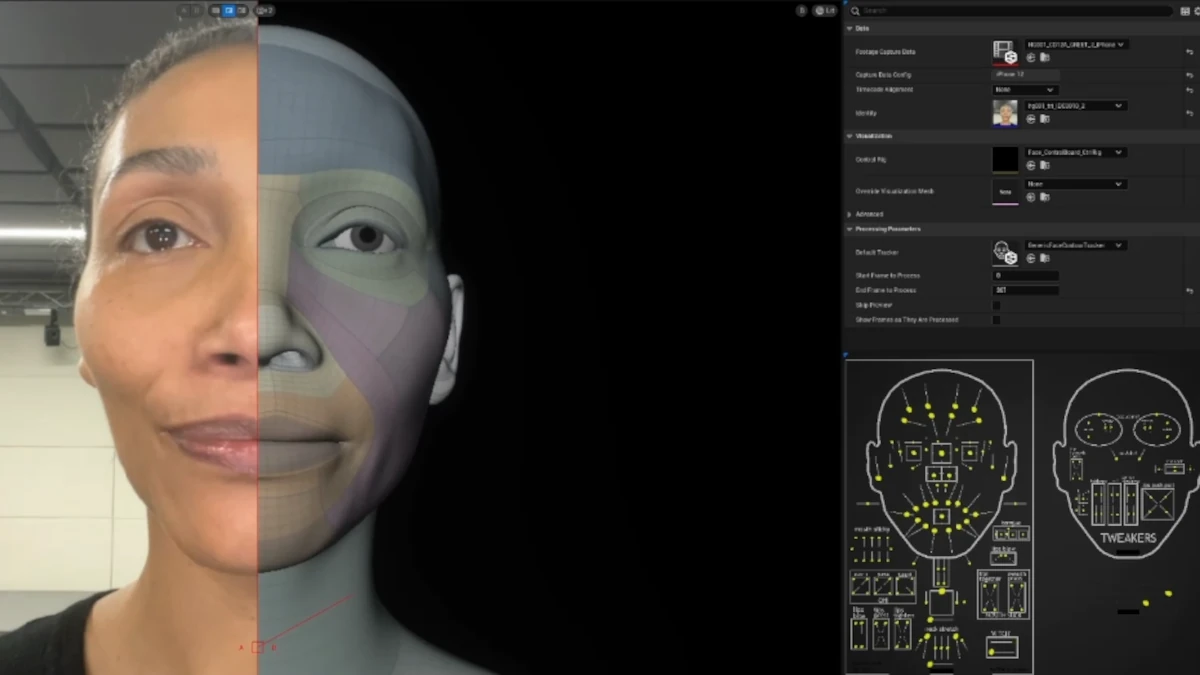

La clave está en asegurar que el sistema comprenda la anatomía única del rostro del actor y cómo debe relacionarse con el personaje objetivo. MetaHuman Animator comienza creando una Identidad de MetaHuman de tu intérprete: una malla que tiene la misma topología y comparte el mismo rig estándar que todos los MetaHumans.

Si has utilizado Mesh to MetaHuman, sabrás que parte de ese proceso crea una Identidad de MetaHuman a partir de un escaneo o esculpido 3D; MetaHuman Animator se basa en esa tecnología para permitir que las Identidades de MetaHuman se creen a partir de una pequeña cantidad de metraje capturado. El proceso solo tarda unos minutos y solo necesita hacerse una vez para cada actor.

Con ese paso completo, la Identidad de MetaHuman se utiliza para interpretar la actuación rastreando y resolviendo las posiciones del esqueleto facial de MetaHuman. El resultado es que cada expresión sutil se recrea con precisión en tu personaje de MetaHuman de destino, independientemente de las diferencias entre las características del actor y las del MetaHuman. En Unreal Engine, puedes confirmar visualmente que la actuación se está transmitiendo y comparar la Identidad de MetaHuman animada con la grabación del actor, fotograma a fotograma.

Esqueletos faciales que nos ayudan en el paso a paso

Otra ventaja es que los datos de animación son limpios; las curvas de control son semánticamente correctas, es decir, están donde se espera que estén en los controles del esqueleto facial, tal como lo estarían si hubieran sido creadas por un animador humano, lo que las hace fáciles de ajustar si es necesario con fines artísticos.

Dado que hemos utilizado una Identidad de MetaHuman desde el principio, puedes estar seguro de que la animación que crees hoy seguirá funcionando si realizas cambios en tu MetaHuman en el futuro o si deseas utilizarla en cualquier otro MetaHuman.

Las capacidades de procesamiento de MetaHuman Animator formarán parte del complemento MetaHuman para Unreal Engine, que, al igual que el motor en sí, se puede descargar de forma gratuita. Si deseas utilizar un iPhone, MetaHuman Animator funcionará con un iPhone 11 o posterior, y también necesitarás la aplicación gratuita Live Link Face para iOS, que se actualizará con algunos modos de captura adicionales para admitir este flujo de trabajo.

¿No puedes esperar para empezar? Asegúrate de seguir este hilo y te informaremos cuando esté disponible MetaHuman Animator.

En el foro puedes encontrar toda la información agrupada y los comentarios sobre MetaHuman, sigue leyendo…